امروز : شنبه, ۹ تیر , ۱۴۰۳

پایداری | متن کامل رایگان | مشکل زمانبندی کارگاه انعطاف پذیر کم کربن بر اساس یادگیری تقویتی عمیق

۴٫۱٫ فرآیند تصمیم گیری مارکوف (MDP) برای پرداختن به LC-FJSP با استفاده از یادگیری تقویتی عمیق، ما در ابتدا حالت ها، اقدامات، انتقال حالت ها و پاداش ها را تعریف می کنیم و مشکل را به یک فرآیند تصمیم گیری مارکوف (MDP) تبدیل می کنیم. سپس یک چارچوب تصمیم مبتنی بر DRL ایجاد میشود که […]

۴٫۱٫ فرآیند تصمیم گیری مارکوف (MDP)

برای پرداختن به LC-FJSP با استفاده از یادگیری تقویتی عمیق، ما در ابتدا حالت ها، اقدامات، انتقال حالت ها و پاداش ها را تعریف می کنیم و مشکل را به یک فرآیند تصمیم گیری مارکوف (MDP) تبدیل می کنیم. سپس یک چارچوب تصمیم مبتنی بر DRL ایجاد میشود که انتخاب عملیات و ماشینها را به طور یکپارچه بررسی میکند و یک توزیع احتمال را برای تصمیمگیری خروجی میدهد. یک استراتژی حریصانه به کار گرفته شده است، با تمرکز بر انتخاب جفت عملیات-ماشین با بالاترین امتیاز. در نهایت، روش آموزشی مدل پیشنهادی را توضیح میدهیم.

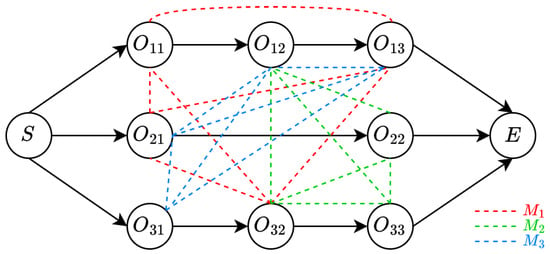

فرآیند زمان بندی در FJSP به عنوان تخصیص یک عملیات آماده به یک ماشین بیکار مناسب تصور می شود. روند کار به صورت زیر است. در هر نقطه تصمیم گیری تی (چه در شروع یا پس از اتمام یک عملیات)، عامل وضعیت فعلی را ارزیابی می کند و یک عمل را انتخاب می کند ، به طور خاص یک عملیات برنامه ریزی نشده را به یک ماشین موجود اختصاص می دهد و اجرای آن را از زمان شروع می کند . متعاقباً، سیستم در مرحله به حالت بعدی منتقل می شود . این توالی تا زمانی ادامه می یابد که همه عملیات ها برنامه ریزی شوند. چارچوب MDP به صورت زیر تعریف می شود:

حالت: نمایش حالت ویژگی ها و پویایی های اولیه محیط زمان بندی را با در نظر گرفتن هر دو فرآیند و ماشین ها به عنوان حالت ترکیبی نشان می دهد. وضعیت جمعی همه فرآیندها و ماشین ها در هر مرحله تصمیم گیری تی حالت را تشکیل می دهد ، با شروع از نمونه اولیه FJSP به عنوان نشان داده شده است .

عمل: این مقاله انتخاب فرآیند و انتساب ماشین را در یک انتخاب اقدام یکپارچه ادغام می کند و تمام جفت های فرآیند-ماشین امکان پذیر را به عنوان فضای عمل تعریف می کند. با پیشرفت برنامه ریزی، فضای عمل به طور طبیعی با تخصیص عملیات بیشتر کاهش می یابد.

انتقال دولت: در هر مرحله تصمیم گیری تی، از ایالت ، عامل یک عمل را از فضای موجود انتخاب می کند و عمل را انجام می دهد ، این منجر به تغییر محیطی به حالت بعدی می شود .

جایزه: هدف از طراحی تابع پاداش، راهنمایی عامل برای انتخاب اقداماتی است که حداکثر زمان تکمیل و انتشار کل کربن همه عملیات را به حداقل می رساند. تابع پاداش در مرحله زمانی تی به عنوان … تعریف شده است ، جایی که f نشان دهنده ارزش است در وضعیت فعلی . زمانی که عامل تخفیف ، انباشت پاداش در هر مرحله نتیجه می دهد . در یک مثال مشکل خاص، ثابت است، به این معنی است که به حداقل رساندن f و به حداکثر رساندن پاداش تجمعی معادل هستند.

خط مشی: ما یک سیاست تصادفی اتخاذ می کنیم ، که توزیع احتمال را بر روی مجموعه اقدامات تعریف می کند برای هر ایالت . توزیع این خط مشی توسط یک الگوریتم یادگیری تقویتی عمیق ایجاد می شود که پارامترهای خاصی را در طول آموزش بهینه می کند تا پاداش تجمعی را به حداکثر برساند.

به عنوان مثال، یک سناریوی ساده را در نظر بگیرید که در آن دو شغل وجود دارد، و ، هر کدام با یک عملیات، و ، به ترتیب، و سه ماشین، ، ، و . در یک نقطه تصمیم گیری تی، هر دو و آماده پردازش هستند.

در زمان تی، وضعیت فعلی شامل وضعیت کلیه مشاغل و ماشین آلات می باشد. برای مثال، عملیات در انتظار تکلیف است، عملیات در انتظار تعیین تکلیف است و همه ماشین ها ، ، و بیکار هستند

فضای عمل شامل تمام تکالیف ماشینی ممکن است. در این سناریو، اقدامات ممکن عبارتند از:

- ۱٫

-

اختصاص دهید به ;

- ۲٫

-

اختصاص دهید به ;

- ۳٫

-

اختصاص دهید به ;

- ۴٫

-

اختصاص دهید به ;

- ۵٫

-

اختصاص دهید به ;

- ۶٫

-

اختصاص دهید به .

فرض کنید عامل اقدامی را که باید اختصاص داده شود انتخاب می کند به سیستم به حالت بعدی منتقل می شود جایی که در حال پردازش است . به عنوان مثال، وضعیت جدید می تواند به صورت زیر باشد: در حال اجرا است با زمان تکمیل مورد انتظار ۵ واحد، هنوز در انتظار تعیین تکلیف است، و بیکار بماند

پاداش این عمل بر اساس کاهش متریک ترکیبی حداکثر زمان تکمیل محاسبه می شود () و کل انتشار کربن (). فرض کنید در حالت است که ۲۰ است و ۳۰ است. پس از انتقال به حالت ، به ۱۹ کاهش می یابد و به ۲۸ کاهش می یابد. تابع پاداش به عنوان … تعریف شده است ، جایی که f نشان دهنده مجموع وزنی از و . با فرض مساوی وزن و ; از این رو، .

با در نظر گرفتن هر دو انتخاب فرآیند و انتساب ماشین در اقدامات، عامل به طور موثر یاد میگیرد که حجم کار را متعادل کند و معیارهای عملکرد کلی را در LC-FJSP بهینه کند.

۴٫۲٫ شبکه توجه کم کربن (LCGAN)

۴٫۲٫۱٫ ماژول توجه ویژگی عملیات

جایی که و برای همه تبدیلات خطی هستند .

ما تابع فعالسازی LeakyReLU را نسبت به ReLU استاندارد به دلایل مختلفی انتخاب کردیم. در مرحله اول، LeakyReLU به کاهش مشکل “ReLU در حال مرگ” کمک می کند، و اطمینان حاصل می کند که نورون ها فعال می مانند و گرادیان ها در طول آموزش جریان دارند، که برای ماژول توجه ویژگی عملکرد ما بسیار مهم است. ثانیا، آزمایشهای اولیه ما وجود ویژگیهای پر سر و صدا و نقاط پرت را در مجموعه داده نشان داد. شیب منفی کوچک LeakyReLU اجازه می دهد تا زمانی که واحدها غیرفعال هستند، شیب های غیرصفری ایجاد شود و به مدل کمک می کند تا نویز و نقاط پرت را قوی تر مدیریت کند. در نهایت، توانایی LeakyReLU برای ارائه گرادیان برای ورودی های منفی به انتشار گرادیان بهتر کمک می کند، به ویژه برای شبکه های عمیق مفید است.

با اتصال متوالی چندین ماژول توجه ویژگی عملکرد، پیام می تواند به همه عملیات در داخل منتشر شود .

۴٫۲٫۲٫ ماژول توجه ویژگی ماشین

جایی که و ماتریس های وزنی هستند و یک تبدیل خطی است.

نشان دهنده مجموعه ای از عملیات برنامه ریزی نشده است که می تواند پردازش کند. را می توان معیاری برای قابلیت پردازش، و ما به طور مشابه از فرمول بالا برای محاسبه استفاده می کنیم . سپس، ضرایب توجه نرمال شده با استفاده از نرم افزار مکس به دست می آیند و ویژگی های ورودی تبدیل شده با ELU ترکیب و فعال می شوند تا ویژگی خروجی ماشین به دست آید. .

۴٫۲٫۳٫ ماژول توجه چند سر

ما از سرهای توجه متعدد برای پردازش ماژول های فوق الذکر استفاده می کنیم، با هدف یادگیری روابط متنوع بین موجودیت ها. اجازه دهید اچ تعداد سرهای توجه را در لایه توجه نشان دهید. درخواست می کنیم ماژول های مکانیسم توجه که هر کدام شامل پارامترهای متفاوتی هستند. در مرحله اول، محاسبات موازی برای استخراج ضرایب توجه و ترکیبات انجام می شود. در مرحله دوم، خروجی های آنها از طریق یک عملگر تجمیع یکپارچه می شوند. ما concat را به عنوان عملگر تجمیع پذیرفته ایم و یک عملگر متوسط در آخرین لایه استفاده می شود. در نهایت، یک تابع فعال سازی برای به دست آوردن خروجی لایه اعمال می شود.

۴٫۲٫۴٫ ادغام نمودار

۴٫۴٫ بهینه سازی بیزی

برای به روز رسانی مدل فرآیند گاوسی، باید مقدار تابع را رعایت کنیم در نقطه ، و سپس اضافه کنید ، به نقاط نمونه و مقادیر تابع. در ادامه، با استفاده از قضیه بیزی و روشهای رگرسیون فرآیند گاوس، بردار میانگین و ماتریس کوواریانس مدل فرآیند گاوس بهروزرسانی میشوند.

جایی که و میانگین مقادیر C و E را به ترتیب در فضای ورودی نشان می دهد و نشان دهنده مقدار میانگین مقادیر تابع در تمام نقاط فضای ورودی است.

منبع:

۱- shahrsaz.ir , پایداری | متن کامل رایگان | مشکل زمانبندی کارگاه انعطاف پذیر کم کربن بر اساس یادگیری تقویتی عمیق

,۲۰۲۴-۰۵-۲۷ ۰۳:۳۰:۰۰

۲- https://www.mdpi.com/2071-1050/16/11/4544

اساس , انعطاف , بر , پایداری , پذیر , تقویتی , رایگان , زمانبندی , عمیق , کارگاه , کامل , کربن , کم , متن , مشکل , یادگیری

- دیدگاه های ارسال شده توسط شما، پس از تایید توسط تیم مدیریت در وب منتشر خواهد شد.

- پیام هایی که حاوی تهمت یا افترا باشد منتشر نخواهد شد.

- پیام هایی که به غیر از زبان فارسی یا غیر مرتبط باشد منتشر نخواهد شد.